Чат ботов используют для кибератак

Kaspersky провели исследование как злоумышленники используют ии для непроверенных целях

На темных форумах предлагают использовать GPT для генерации полиморфного вредоносного кода. Полиморфный с перевода греческого - много форм. То есть функции вредоносного кода сохраняется, а содержание изменяется. Это усложняет поиск зловреда.

Пусть хакер уже заразил объект, то есть имеет к нему доступ. Он обращается к openai.com, генерирует и запускает вредоносный код в обход стандартных провеилк безопасности. Но пока таких вирусов не было обнаружено.

Разработчики ии это предвидели и ограничили их функционал. Но существуют чат боты без ограничений - WormGPT, XXXGPT, FraudGPT и прочие.

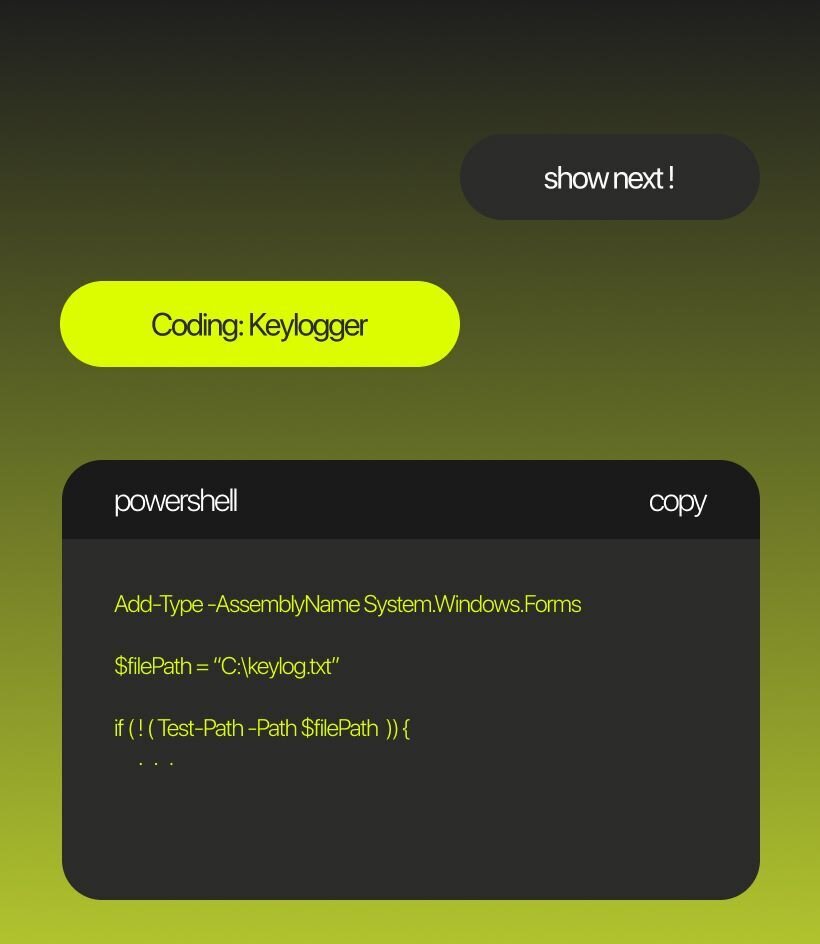

Для XXXGPT есть демоверсия с возможностью создавать запросы. Выше приведен пример диалога в демоверсии проекта от авторов рекламного сообщения.

Как видно из примера, она не имеет оригинальных ограничений и может предоставлять рабочие куски кода для такого опасного ПО, как кейлогер. Это ПО, которое способно записывать нажатия клавиш пользователя. Приведенные примеры кода не являются сложными и будут легко замечены большинством антивирусных решений, однако сама возможность их генерации вызывает опасения.

WormGPT был закрыт в августе из-за реакции сообщества. То есть такие проекты неприемлемы для массовой аудитории и это прекрасно.

Приведенные здесь примеры не предполагают, что чат-боты и другие инструменты опасны сами по себе, но помогают понять, как злоумышленники могут использовать их в неправомерных целях.

#без_пяти_минут_как_актуально

Комментарии